HakkoAI basiert auf LynkSoul VLM v1 – einem visuellen Sprachmodell, das von unserem Team entwickelt und auf riesigen Mengen an Spieldaten trainiert wurde. Dies ermöglicht es der KI, Gameplay-Szenarien mit außergewöhnlicher visueller Wahrnehmung wirklich zu sehen und zu verstehen. Dank seiner hochspezialisierten Ausbildung gilt LynkSoul VLM v1 als das effektivste visuelle Sprachmodell für Spiele.

Fachwissen

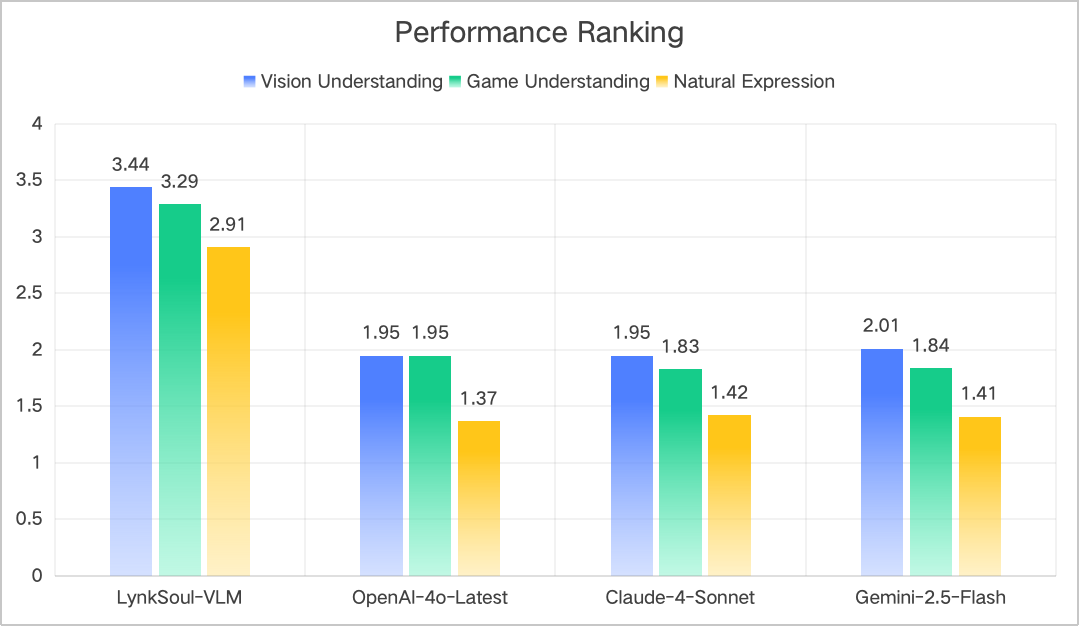

In League of Legends-Testszenarien haben wir einen Bildtestsatz mit mehr als 500 Beispielen erstellt, der die überwiegende Mehrheit der Schlüsselszenarien abdeckt. Die Ergebnisse zeigen, dass LynkSoul VLM v1 allgemeine Sehmodelle in Bezug auf Erkennungsgenauigkeit, Praktikabilität von Vorschlägen und Natürlichkeit des Sprachausdrucks deutlich übertrifft.

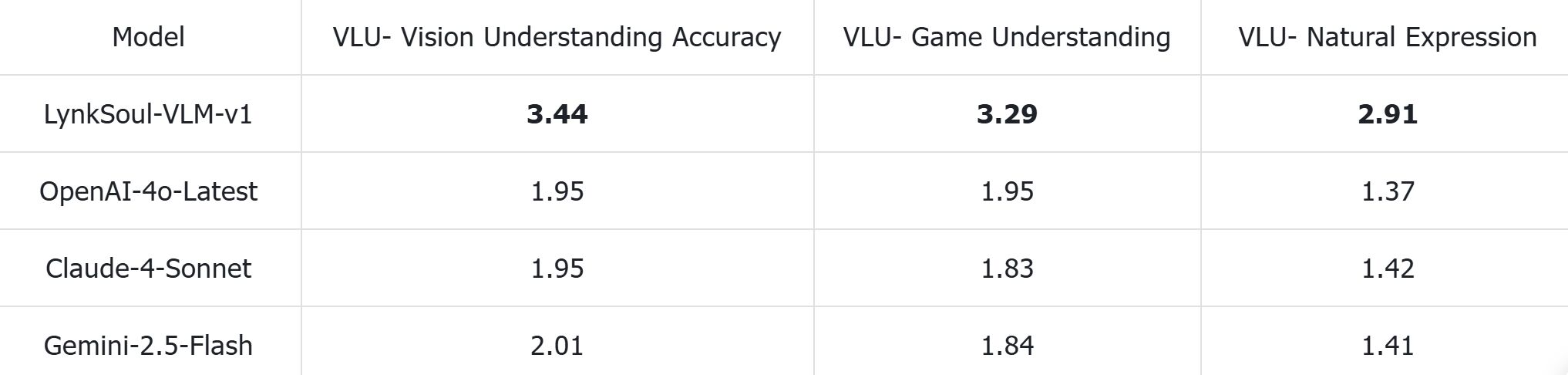

Verallgemeinerung

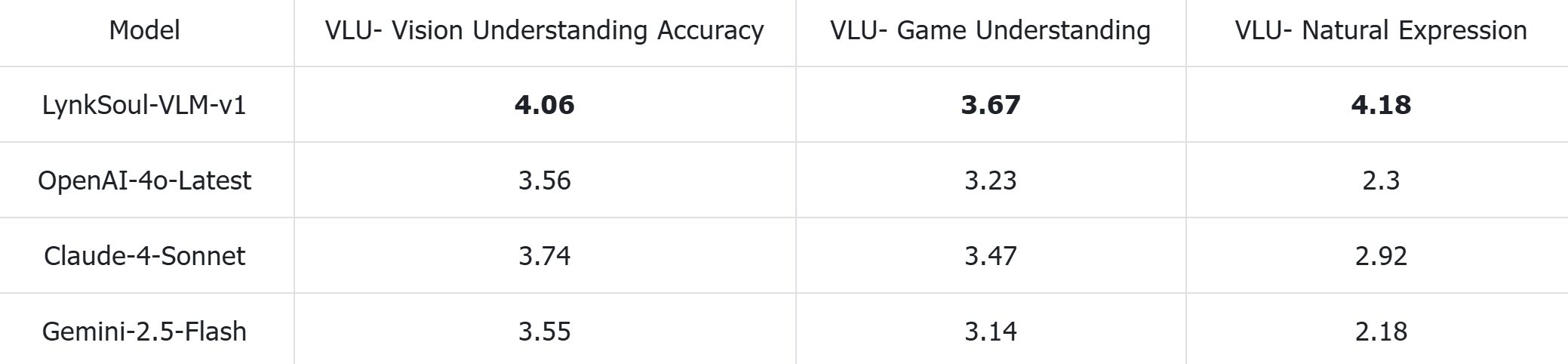

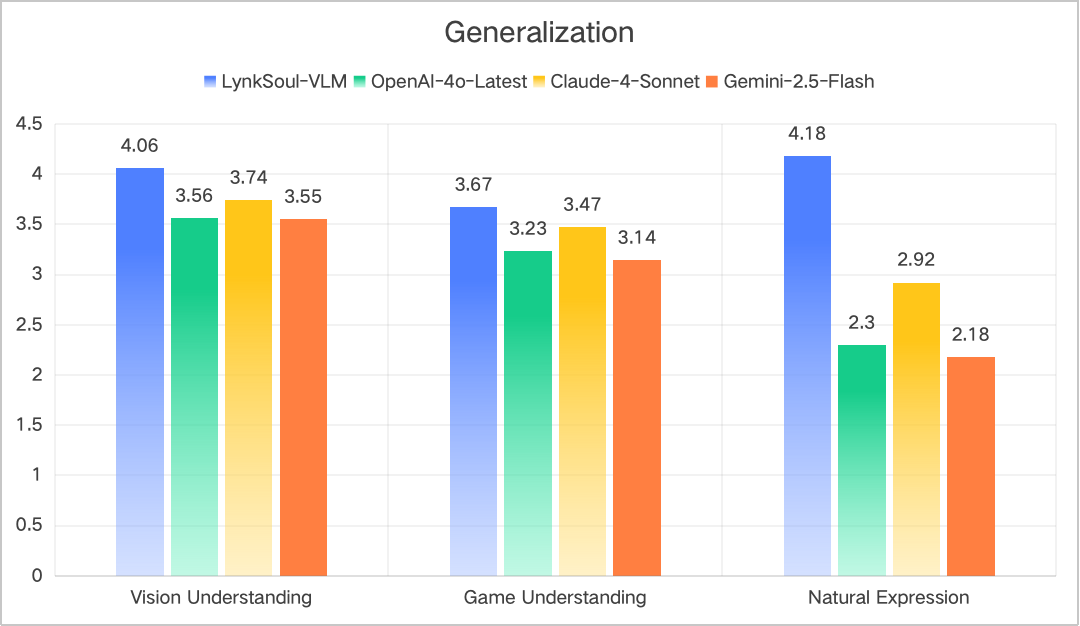

Um die Generalisierungsfähigkeit unseres Modells zu bewerten, haben wir einen Testdatensatz erstellt, der mehrere Spiele enthält, die vom Training ausgeschlossen wurden. Angesichts der begrenzten Verfügbarkeit von Online-Daten für einige Titel haben wir absichtlich solche Spiele mit knappen Daten ausgewählt, um die Leistung des Modells bei unsichtbaren Inhalten zu bewerten.

Experimentelle Ergebnisse zeigen, dass LynkSoul-VLM-v1 eine starke Generalisierungsleistung erzielt. Bei drei Schlüsselkennzahlen – Genauigkeit des visuellen Verständnisses, Verständnis des Gameplays und Ausdruck in natürlicher Sprache – übertrifft es durchweg die Basismodelle, darunter OpenAI-4o-Latest, Claude-4-Sonnet und Gemini-2.5-Flash.

Die Ergebnisse bestätigen, dass LynkSoul-VLM-v1 eine robuste Generalisierung in ressourcenarmen Spielumgebungen aufweist und einen effektiven domänenübergreifenden Wissenstransfer demonstriert.

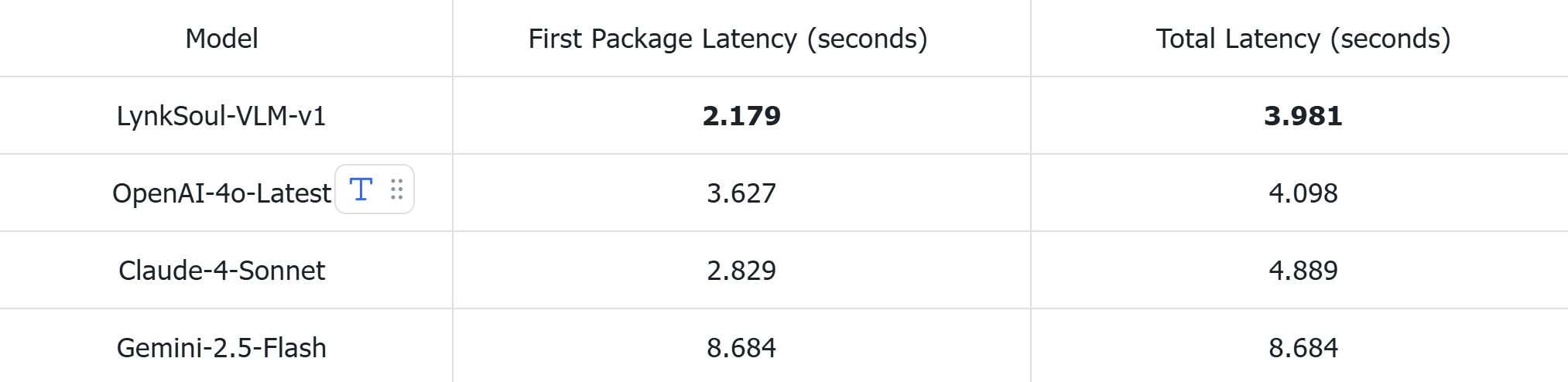

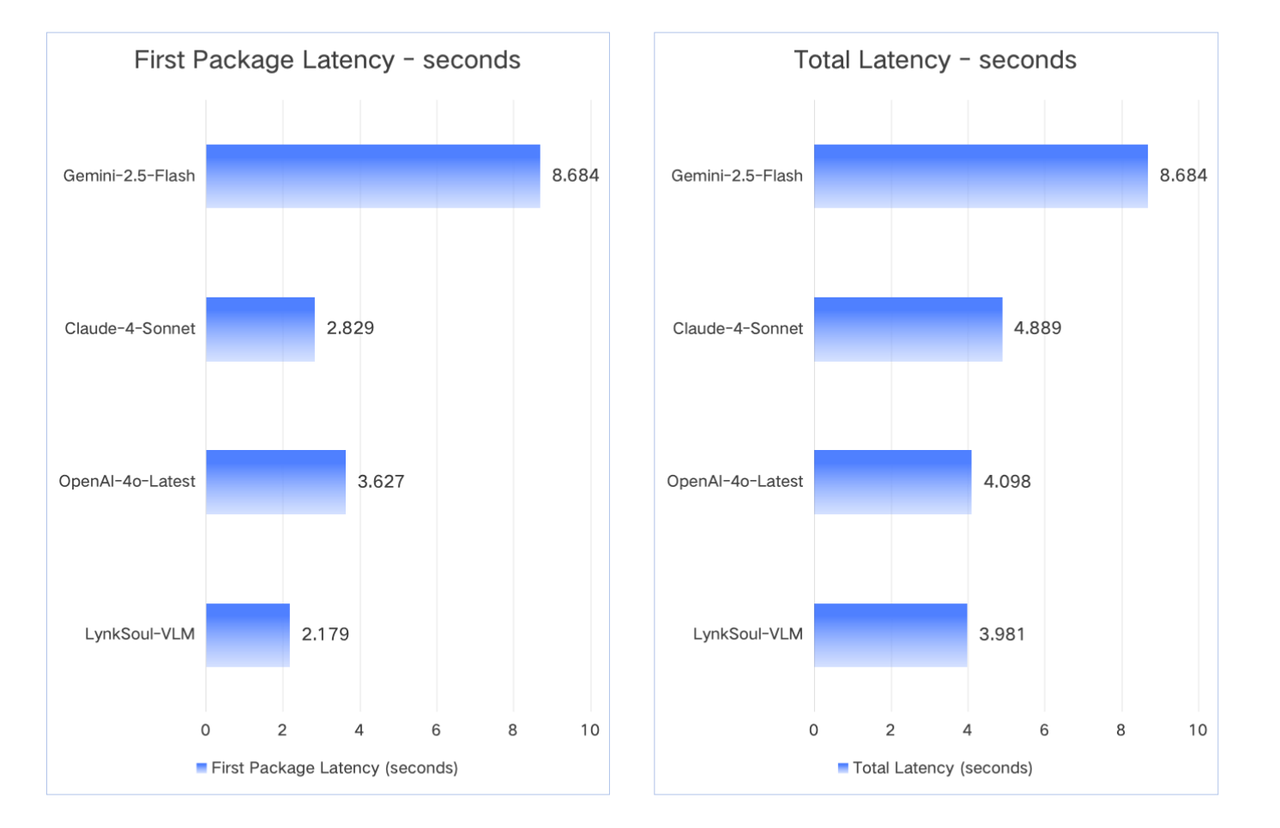

Geschwindigkeit und Kosten

Neben der Genauigkeit legen wir gleichermaßen Wert auf die Inferenzgeschwindigkeit. Aufgrund der dynamischen Pfadauswahl des Hybridmodellsystems weist LynkSoul-VLM-v1 erhebliche Vorteile bei der Inferenzgeschwindigkeit auf.

Ergebnisse des Inferenzlatenzvergleichs: